LLM 추론의 3대 병목

DeepSeek V4 등 초대규모 모델이 조 단위 파라미터를 넘어서면서 기존 GPU + DRAM 아키텍처는 메모리 용량, 스토리지 대역폭, 운영 비용의 3가지 병목에 직면하고 있습니다.

메모리 벽

671B 파라미터 모델은 1.2TB+ 메모리가 필요합니다. 단일 노드 GPU HBM 용량이 크게 부족하고 KV-Cache는 컨텍스트 길이에 따라 선형적으로 증가합니다.

스토리지 대역폭

Prefill 단계에서 SSD에서 수백 GB의 모델 가중치를 로드해야 하며, 기존 단일 경로 PCIe 대역폭이 주요 병목이 됩니다.

운영 비용

대규모 GPU 클러스터의 전력 및 냉각 비용이 계속 상승하여 토큰당 추론 비용을 상업적으로 실행 가능한 수준으로 낮추기 어렵습니다.

3대 핵심 기술 기둥

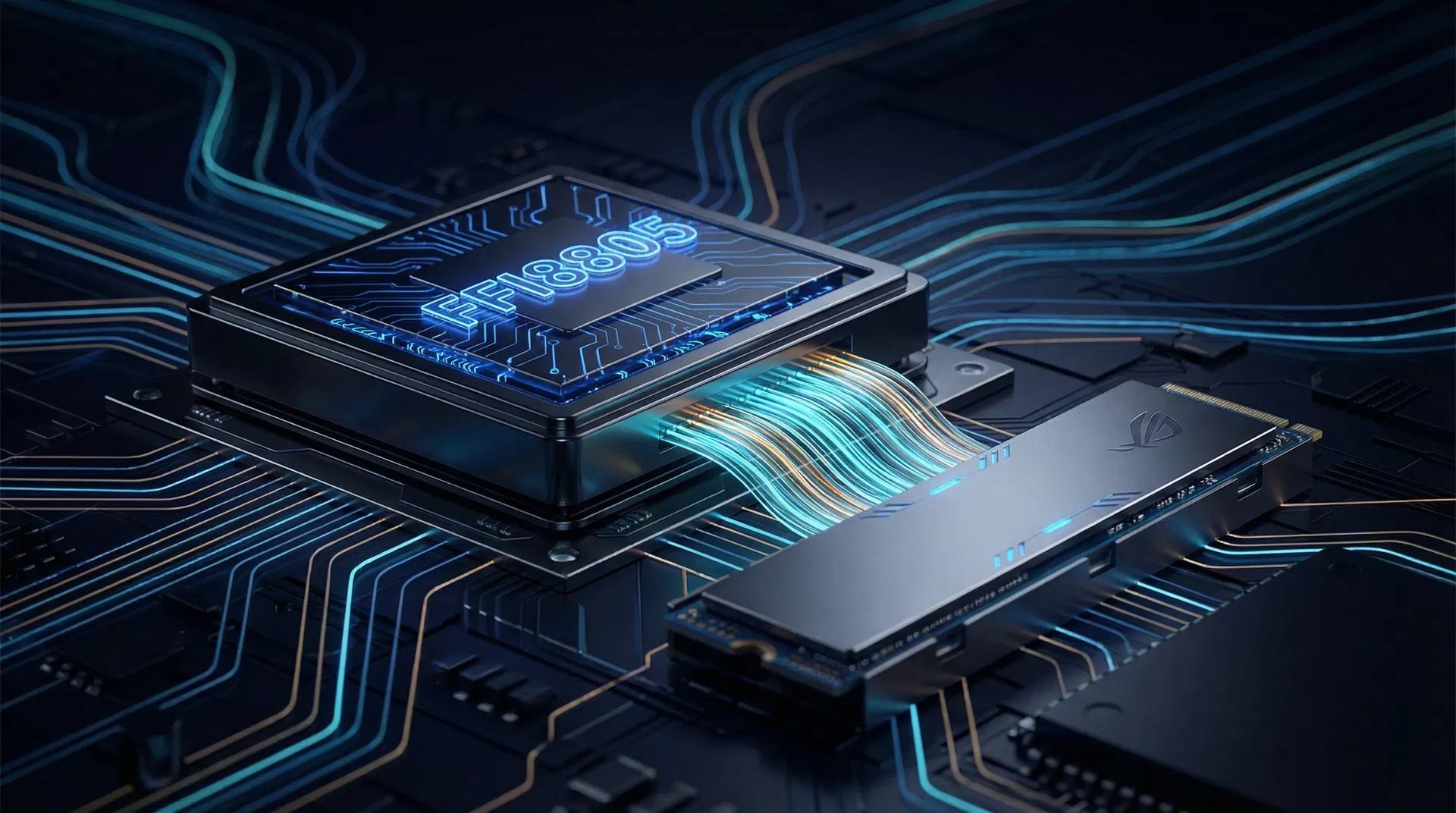

FFI8805 Premium은 3가지 혁신 기술을 통합하여 모델 메모리, 데이터 경로, 스토리지 미디어 전반에서 LLM 추론을 최적화합니다.

DeepSeek V4 Engram 영구 메모리 엔진

Engram은 DeepSeek V4가 도입한 네이티브 영구 메모리 메커니즘으로, 고빈도 지식을 O(1) 쿼리 가능한 구조화 메모리로 압축하여 KV-Cache의 선형 성장을 대체합니다.

V4 vs V3 벤치마크 향상

DualPath 대역폭 최적화

DualPath는 AI 학습 클러스터의 유휴 DE 노드 SNIC을 활용하여 SSD→DE DRAM→CNIC RDMA→GPU의 제2 데이터 경로를 엽니다.

AI 인식 SSD NAND IP 아키텍처

5계층 AI 인식 아키텍처는 NAND 어레이부터 가속 계층까지 전면 재설계되어 SSD 컨트롤러가 AI 워크로드 액세스 패턴을 이해합니다.

하드웨어 사양 개요

FFI8805 Premium은 CIM AI 가속 코어, SSD 컨트롤러, NAND 어레이를 단일 2.5" U.2 모듈에 통합합니다. 각 서브시스템의 전체 사양은 아래와 같습니다.